论文信息: Training-Time-Friendly Network for Real-Time Object Detection

代码链接:https://github.com/ZJULearning/ttfnet

问题: 这篇论文主要是解决CenterNet存在的一些问题,CenterNet在推理速度精度上表现不差,但存在训练耗时的问题,CenterNet官方代码训练coco需要2.5天,因此这篇论文主要是如何改进CenterNet训练耗时长的问题。作者基于CenterNet,在回归box时,作者认为由于CenterNet进行回归时仅仅使用中心点的那些目标是次优的选择,同时作者借助了FCOS是使用Ground Truth回归所有样本的思想,这里作者想到使用高斯核来选择回归样本,一方面可以增加回归的信息量,提升检测精度,同时作者指出这样有增加batch size的效果,可以使用更大的学习率以及有更短的训练时间。并且没有引入FCOS中耗时的NMS后处理过程,使得Inference时间减小。

该方法优势:

- 使用高斯核编码训练样本,使得网络能够更快地收敛;

- 能够在不引入其他组件,比如FPN的基础上,降低ambiguous 以及low-quality的样本;

- 不需要any offset predictions来矫正结果;

具体思路:

给定一张图片,利用网络分别预测物体中心在什么位置 $\hat{H} \in R^{N \times C \times \frac{H}{r} \times \frac{W}{r}}$和回归box size的向量 $\hat{S} \in R^{N \times 4 \times \frac{\dot{H}}{r} \times \frac{W}{r}}$ 在分类和回归时同时使用高斯核,并通过 $\alpha$ 和 $\beta$ 控制高斯核的尺寸。这里和CenterNet一样,将目标检测分为两个部分:object localization和 size regression;

1.object localization

假设一张图上有M个annotated box,其中第m个标注box属于$c_m$ 类别,二维的高斯核:

高斯分布的峰值,也就是box中心,被视为正目标,而任何其他像素被视为负目标。对那些与较大的分配值对应的负目标的惩罚将会减轻。使用修正 focal loss.

2. size regression

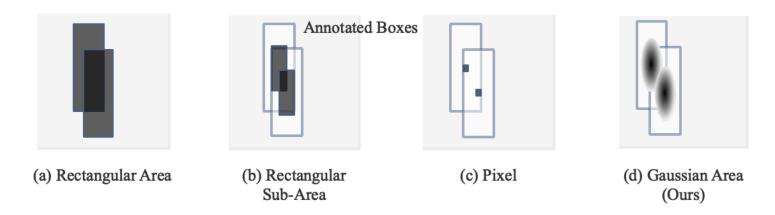

给定特征图尺度上的m个ground truth box,采用另一个高斯核生成 $S_{m} \in R^{1 \times \frac{H}{r} \times \frac{W}{r}}$,核大小是由β 如上所述控制。Sm中的非零部分称为高斯区域Am,如图3所示。由于Am总是在它们的框中,所以在本文的其余部分中,它也被称为子区域。将子区域中的每个像素作为训练样本。损失函数部分使用的是GIOU loss。

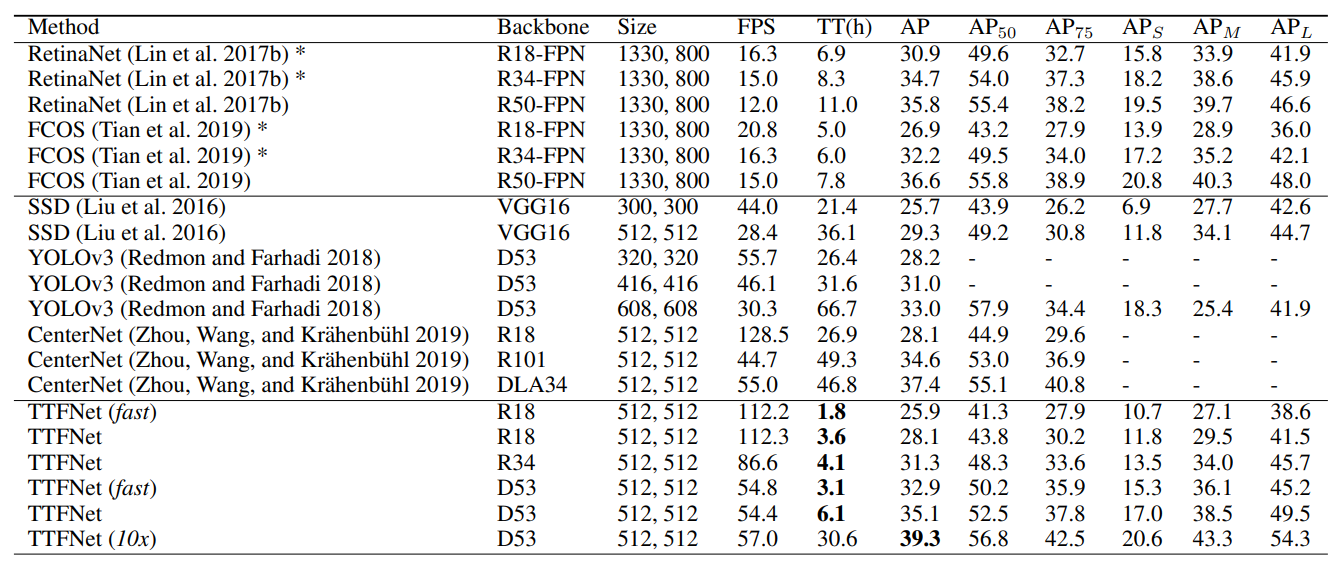

3. experiment